Aujourd'hui, nous partageons publiquement de Microsoft Norme d’IA responsableun cadre pour guider la façon dont nous construisons des systèmes d'IA. Il s’agit d’une étape importante dans notre démarche visant à développer une IA meilleure et plus fiable. Nous publions notre dernière norme sur l'IA responsable pour partager ce que nous avons appris, solliciter les commentaires des autres et contribuer à la discussion sur l'élaboration de meilleures normes et pratiques autour de l'IA.

Guider le développement de produits vers des résultats plus responsables

Les systèmes d’IA sont le produit de nombreuses décisions différentes prises par ceux qui les développent et les déploient. De l’objectif du système à la manière dont les gens interagissent avec les systèmes d’IA, nous devons orienter ces décisions de manière proactive vers des résultats plus bénéfiques et plus équitables. Cela signifie garder les personnes et leurs objectifs au centre des décisions de conception du système et respecter des valeurs durables telles que l'équité, la fiabilité et la sûreté, la confidentialité et la sécurité, l'inclusivité, la transparence et la responsabilité.

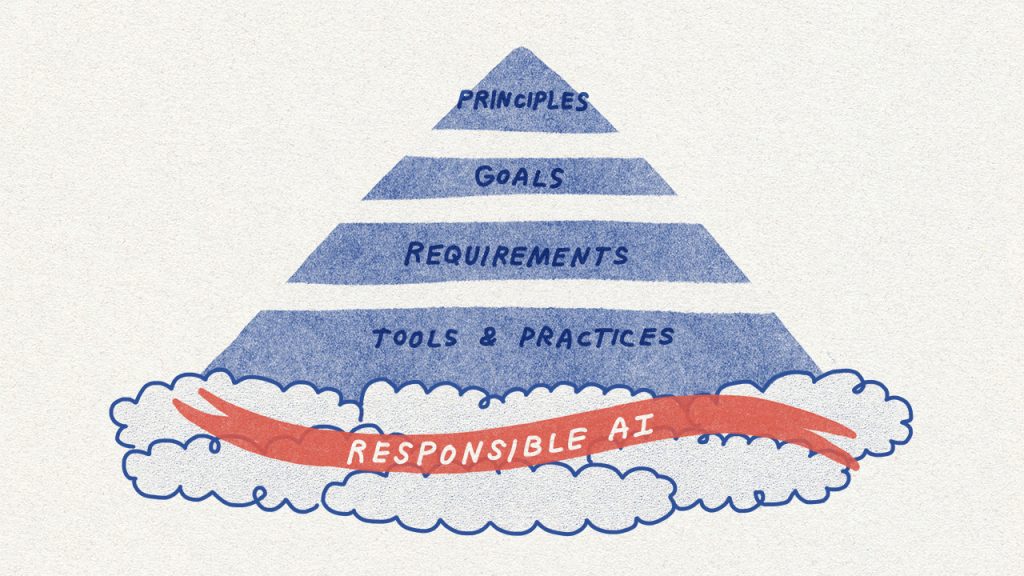

La norme sur l’IA responsable expose nos meilleures réflexions sur comment nous construirons des systèmes d'IA pour défendre ces valeurs et gagner la confiance de la société. Il fournit des conseils spécifiques et exploitables à nos équipes qui vont au-delà des principes de haut niveau qui ont dominé le paysage de l'IA jusqu'à présent.

La norme détaille les objectifs ou les résultats concrets que les équipes développant des systèmes d’IA doivent s’efforcer d’atteindre. Ces objectifs aident à décomposer un principe général tel que la « responsabilité » en ses principaux catalyseurs, tels que les évaluations d'impact, la gouvernance des données et la surveillance humaine. Chaque objectif est ensuite composé d'un ensemble d'exigences, qui sont des étapes que les équipes doivent suivre pour garantir que les systèmes d'IA atteignent les objectifs tout au long du cycle de vie du système. Enfin, la norme associe les outils et pratiques disponibles à des exigences spécifiques afin que les équipes Microsoft qui la mettent en œuvre disposent des ressources nécessaires pour les aider à réussir.

Le besoin de ce type de conseils pratiques augmente. L’IA fait de plus en plus partie de nos vies, et pourtant, nos lois sont à la traîne. Ils n’ont pas pris en compte les risques spécifiques à l’IA ni les besoins de la société. Même si nous constatons des signes indiquant que l’action gouvernementale en matière d’IA s’étend, nous reconnaissons également notre responsabilité d’agir. Nous pensons que nous devons œuvrer pour garantir que les systèmes d’IA soient responsables intentionnellement.

Affiner notre politique et tirer les leçons de nos expériences produits

Au cours d'une année, un groupe multidisciplinaire de chercheurs, d'ingénieurs et d'experts en politiques ont élaboré la deuxième version de notre norme sur l'IA responsable. Il s'appuie sur notre efforts antérieurs en matière d’IA responsable, y compris la première version de la norme lancée en interne à l'automne 2019, ainsi que les dernières recherches et certains leçons importantes tirées de nos propres expériences de produits.

Équité dans la technologie de synthèse vocale

Le potentiel des systèmes d’IA à exacerber les préjugés et les inégalités sociétales est l’un des préjudices les plus largement reconnus associés à ces systèmes. En mars 2020, un universitaire étude a révélé que la technologie de synthèse vocale dans le secteur technologique produisait des taux d'erreur pour les membres de certaines communautés noires et afro-américaines qui étaient presque le double de ceux des utilisateurs blancs. Nous avons pris du recul, examiné les résultats de l'étude et appris que nos tests préliminaires n'avaient pas pris en compte de manière satisfaisante la riche diversité de discours de personnes d'origines et de régions différentes. Après la publication de l'étude, nous avons engagé un sociolinguiste expert pour nous aider à mieux comprendre cette diversité et avons cherché à étendre nos efforts de collecte de données pour réduire l'écart de performance de notre technologie de synthèse vocale. Au cours de ce processus, nous avons constaté que nous devions nous attaquer à des questions difficiles sur la meilleure façon de collecter des données auprès des communautés de manière à les impliquer de manière appropriée et respectueuse. Nous avons également appris l'intérêt de faire intervenir des experts dès le début du processus, notamment pour mieux comprendre les facteurs susceptibles d'expliquer les variations dans les performances du système.

La norme Responsible AI enregistre le modèle que nous avons suivi pour améliorer notre technologie de synthèse vocale. Alors que nous continuons à déployer la norme dans l’ensemble de l’entreprise, nous espérons que les objectifs et les exigences en matière d’équité qui y sont identifiés nous aideront à anticiper les préjudices potentiels en matière d’équité.

Commandes d'utilisation appropriée pour la voix neuronale personnalisée et la reconnaissance faciale

Azure IA Voix neuronale personnalisée est une autre technologie vocale innovante de Microsoft qui permet la création d'une voix synthétique dont le son est presque identique à la source originale. AT&T a donné vie à cette technologie avec un système primé en magasin Bugs Lapin expérience, et Progressif a apporté la voix de Flo aux interactions clients en ligne, parmi les utilisations par de nombreux autres clients. Cette technologie a un potentiel passionnant en matière d’éducation, d’accessibilité et de divertissement, mais il est également facile d’imaginer comment elle pourrait être utilisée pour usurper l’identité des orateurs et tromper les auditeurs.

Notre examen de cette technologie via notre programme d'IA responsable, y compris le processus d'examen des utilisations sensibles requis par la norme d'IA responsable, nous a conduit à adopter un cadre de contrôle à plusieurs niveaux : nous avons restreint l'accès des clients au service, veillé à ce que les cas d'utilisation acceptables soient définis et communiqués de manière proactive. à travers un Note de transparence et Code de conduite, et des garde-fous techniques établis pour garantir la participation active de l'orateur lors de la création d'une voix synthétique. Grâce à ces contrôles et à d'autres, nous a contribué à protéger contre les abus, tout en maintenant les utilisations bénéfiques de la technologie.

En nous appuyant sur ce que nous avons appris de Custom Neural Voice, nous appliquerons des contrôles similaires à notre reconnaissance faciale. prestations de service. Après une période de transition pour les clients existants, nous limitons l'accès à ces services aux clients et partenaires gérés, limitant les cas d'utilisation à des cas d'utilisation acceptables prédéfinis et tirant parti des contrôles techniques intégrés aux services.

Adapté à l’usage prévu et capacités Azure Face

Enfin, nous reconnaissons que pour que les systèmes d’IA soient dignes de confiance, ils doivent constituer des solutions appropriées aux problèmes qu’ils sont censés résoudre. Dans le cadre de notre travail visant à aligner notre service Azure Face sur les exigences de la norme Responsible AI, nous sommes également capacités à la retraite qui déduisent des états émotionnels et des attributs d’identité tels que le sexe, l’âge, le sourire, la pilosité faciale, les cheveux et le maquillage.

En prenant comme exemple les états émotionnels, nous avons décidé de ne pas fournir un accès API illimité à une technologie capable de scanner les visages des gens et de prétendre déduire leurs états émotionnels en fonction de leurs expressions faciales ou de leurs mouvements. Des experts à l'intérieur et à l'extérieur de l'entreprise ont souligné l'absence de consensus scientifique sur la définition des « émotions », les difficultés liées à la manière dont les inférences se généralisent à travers les cas d'utilisation, les régions et les données démographiques, ainsi que les préoccupations accrues en matière de confidentialité autour de ce type de fonctionnalité. Nous avons également décidé que nous devions analyser attentivement tous Systèmes d'IA censés déduire les états émotionnels des personnes, que ces systèmes utilisent l'analyse faciale ou toute autre technologie d'IA. L’objectif et les exigences adaptés à l’objectif de la norme d’IA responsable nous aident désormais à effectuer dès le départ des évaluations de validité spécifiques au système, et notre processus d’utilisations sensibles nous aide à fournir des conseils nuancés pour les cas d’utilisation à fort impact, fondés sur la science.

Ces défis du monde réel ont éclairé le développement de la norme d'IA responsable de Microsoft et démontrent son impact sur la façon dont nous concevons, développons et déployons des systèmes d'IA.

Pour ceux qui souhaitent approfondir notre approche, nous avons également mis à disposition des ressources clés qui soutiennent la norme sur l'IA responsable : notre Modèle d'évaluation d'impact et guide, et une collection de notes de transparence. Les évaluations d’impact se sont révélées utiles chez Microsoft pour garantir que les équipes explorent en profondeur l’impact de leur système d’IA – y compris ses parties prenantes, les avantages escomptés et les inconvénients potentiels – dès les premières étapes de conception. Les notes de transparence sont une nouvelle forme de documentation dans laquelle nous divulguons à nos clients les capacités et les limites de nos technologies de base, afin qu'ils disposent des connaissances nécessaires pour faire des choix de déploiement responsables.

Un parcours multidisciplinaire et itératif

Notre norme d’IA responsable mise à jour reflète des centaines de contributions à travers les technologies, professions et zones géographiques Microsoft. Il s’agit d’une avancée significative pour notre pratique de l’IA responsable, car elle est beaucoup plus pratique et concrète : elle définit des approches pratiques pour identifier, mesurer et atténuer les dommages à l’avance, et oblige les équipes à adopter des contrôles pour sécuriser les utilisations bénéfiques et protéger les utilisateurs. contre les abus. Vous pouvez en apprendre davantage sur le développement de la norme dans ce

Bien que notre norme constitue une étape importante dans le parcours de Microsoft en matière d’IA responsable, ce n’est qu’une étape. À mesure que nous progressons dans la mise en œuvre, nous nous attendons à rencontrer des défis qui nous obligeront à faire une pause, à réfléchir et à nous ajuster. Notre norme restera un document évolutif, évoluant pour tenir compte des nouvelles recherches, technologies, lois et apprentissages internes et externes à l’entreprise.

Il existe un dialogue mondial riche et actif sur la manière de créer des normes fondées sur des principes et applicables pour garantir que les organisations développent et déploient l’IA de manière responsable. Nous avons bénéficié de cette discussion et continuerons d’y contribuer. Nous pensons que l’industrie, le monde universitaire, la société civile et le gouvernement doivent collaborer pour faire progresser l’état de l’art et apprendre les uns des autres. Ensemble, nous devons répondre à des questions de recherche ouvertes, combler les lacunes en matière de mesure et concevoir de nouvelles pratiques, modèles, ressources et outils.

Un avenir meilleur et plus équitable nécessitera de nouveaux garde-fous pour l’IA. La norme d'IA responsable de Microsoft est une contribution à cet objectif, et nous nous engageons dans le travail de mise en œuvre difficile et nécessaire dans l'ensemble de l'entreprise. Nous nous engageons à être ouverts, honnêtes et transparents dans nos efforts pour réaliser des progrès significatifs.