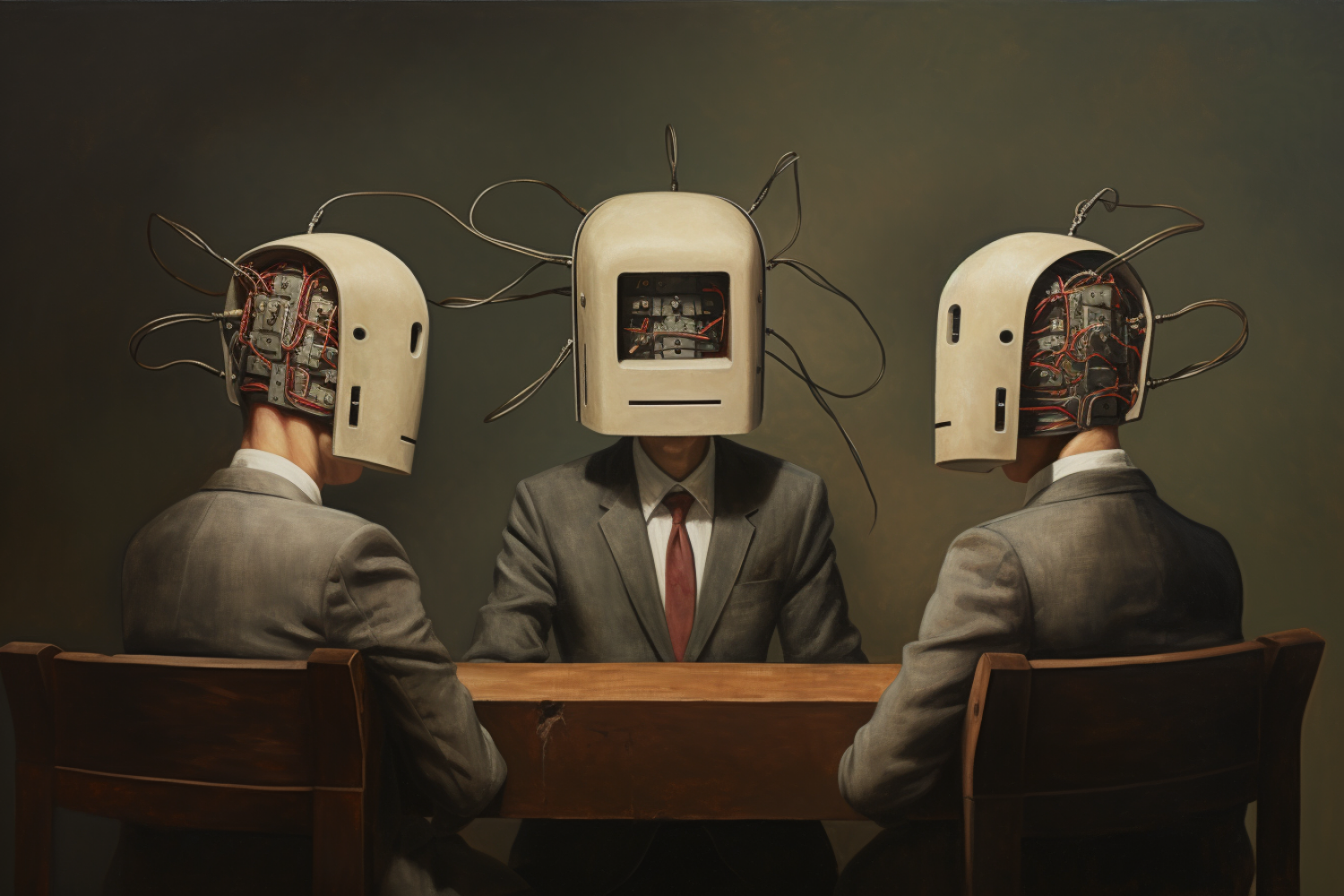

Un adage séculaire, souvent présenté au cours de nos années de formation, est conçu pour nous pousser au-delà de nos esprits naissants et égocentriques : « Deux têtes valent mieux qu’une ». Ce proverbe encourage la réflexion collaborative et met en évidence la puissance de l’intellect partagé.

Avance rapide jusqu’en 2023, et nous constatons que cette sagesse est vraie même dans le domaine de l’intelligence artificielle : plusieurs modèles de langage, fonctionnant en harmonie, valent mieux qu’un.

Récemment, une équipe du Laboratoire d'informatique et d'intelligence artificielle (CSAIL) du MIT a incarné cette sagesse ancienne à la frontière de la technologie moderne. Ils ont introduit une stratégie qui exploite plusieurs systèmes d’IA pour discuter et argumenter les uns avec les autres afin de converger vers la meilleure réponse possible à une question donnée. Cette méthode permet à ces modèles linguistiques expansifs de renforcer leur adhésion aux données factuelles et d'affiner leur prise de décision.

Le nœud du problème avec les grands modèles de langage (LLM) réside dans l’incohérence de leurs réponses générées, conduisant à des inexactitudes potentielles et à des raisonnements erronés. Cette nouvelle approche permet à chaque agent d'évaluer activement les réponses de tous les autres agents et d'utiliser ces commentaires collectifs pour affiner sa propre réponse. En termes techniques, le processus consiste en plusieurs cycles de génération de réponses et de critiques. Chaque modèle de langage génère une réponse à la question donnée, puis intègre les commentaires de tous les autres agents pour mettre à jour sa propre réponse. Ce cycle itératif aboutit au résultat final d'un vote majoritaire sur les solutions des modèles. Cela reflète en quelque sorte la dynamique d’une discussion de groupe – où les individus contribuent à parvenir à une conclusion unifiée et bien motivée.

L’un des véritables atouts de cette approche réside dans son application transparente aux modèles de boîte noire existants. Comme la méthodologie tourne autour de la génération de texte, elle peut également être mise en œuvre dans différents LLM sans avoir besoin d'accéder à leur fonctionnement interne. Selon l'équipe, cette simplicité pourrait aider les chercheurs et les développeurs à utiliser l'outil pour améliorer la cohérence et l'exactitude factuelle des résultats du modèle de langage à tous les niveaux.

« En utilisant une approche nouvelle, nous ne nous appuyons pas simplement sur un seul modèle d'IA pour obtenir des réponses. Au lieu de cela, notre processus fait appel à une multitude de modèles d’IA, chacun apportant des informations uniques pour répondre à une question. Bien que leurs réponses initiales puissent sembler tronquées ou contenir des erreurs, ces modèles peuvent affiner et améliorer leurs propres réponses en scrutant les réponses proposées par leurs homologues », explique Yilun Du, doctorant au MIT en génie électrique et informatique, affilié au MIT CSAIL. , et auteur principal d'un nouveau papier sur le travail. « À mesure que ces modèles d'IA s'engagent dans un discours et une délibération, ils sont mieux équipés pour reconnaître et corriger les problèmes, améliorer leurs capacités de résolution de problèmes et mieux vérifier la précision de leurs réponses. Essentiellement, nous cultivons un environnement qui les oblige à « Plongez plus profondément dans le nœud d'un problème. Cela contraste avec un modèle d'IA unique et solitaire, qui reprend souvent le contenu trouvé sur Internet. Notre méthode, cependant, stimule activement les modèles d'IA pour élaborer des solutions plus précises et plus complètes. »

La recherche a porté sur la résolution de problèmes mathématiques, y compris les problèmes mathématiques des écoles primaires et secondaires, et a constaté une amélioration significative des performances grâce au processus de débat multi-agents. De plus, les modèles linguistiques ont montré des capacités améliorées à générer des évaluations arithmétiques précises, illustrant le potentiel dans différents domaines.

La méthode peut également aider à résoudre le problème des « hallucinations » qui affectent souvent les modèles de langage. En concevant un environnement dans lequel les agents critiquent les réponses des autres, ils ont été davantage incités à éviter de cracher des informations aléatoires et à donner la priorité à l'exactitude factuelle.

Au-delà de son application aux modèles de langage, l’approche pourrait également être utilisée pour intégrer divers modèles dotés de capacités spécialisées. En établissant un système décentralisé dans lequel plusieurs agents interagissent et débattent, ils pourraient potentiellement utiliser ces capacités globales et efficaces de résolution de problèmes à travers diverses modalités telles que la parole, la vidéo ou le texte.

Bien que la méthodologie ait donné des résultats encourageants, les chercheurs affirment que les modèles de langage existants peuvent être confrontés à des défis liés au traitement de contextes très longs et que les capacités de critique pourraient ne pas être aussi raffinées que souhaité. En outre, le format de débat multi-agents, inspiré de l'interaction de groupe humain, n'a pas encore intégré les formes de discussion les plus complexes qui contribuent à une prise de décision collective intelligente – un domaine crucial pour une exploration future, selon l'équipe. Faire progresser la technique pourrait impliquer une compréhension plus approfondie des fondements informatiques derrière les débats et discussions humains, et l’utilisation de ces modèles pour améliorer ou compléter les LLM existants.

« Non seulement cette approche offre une voie pour améliorer les performances des modèles de langage existants, mais elle présente également un moyen automatique d'auto-amélioration. En utilisant le processus de débat comme données supervisées, les modèles de langage peuvent améliorer leur factualité et leur raisonnement de manière autonome, réduisant en s'appuyant sur les commentaires humains et en proposant une approche évolutive d'auto-amélioration », explique Du. « Alors que les chercheurs continuent d'affiner et d'explorer cette approche, nous pouvons nous rapprocher d'un avenir dans lequel les modèles linguistiques imitent non seulement un langage de type humain, mais présentent également une pensée plus systématique et plus fiable, forgeant ainsi une nouvelle ère de compréhension et d'application du langage. »

« Il est tout à fait logique d'utiliser un processus délibératif pour améliorer le résultat global du modèle, et c'est un grand pas en avant par rapport à la chaîne de pensée », déclare Anca Dragan, professeure agrégée au département de génie électrique de l'Université de Californie à Berkeley. et Informatique, qui n'a pas participé aux travaux. « Je suis enthousiasmé par la suite des choses. Les gens peuvent-ils mieux juger les réponses issues des LLM lorsqu'ils voient la délibération, qu'elle converge ou non ? Les gens peuvent-ils parvenir à de meilleures réponses par eux-mêmes en délibérant avec un LLM ? idée peut-elle être utilisée pour aider un utilisateur à examiner la réponse d'un LLM afin d'en arriver à une meilleure ? »

Du a rédigé l'article avec trois affiliés du CSAIL : Shuang Li SM '20, PhD '23 ; Antonio Torralba, professeur de génie électrique et d'informatique au MIT ; et Joshua Tenenbaum, professeur de sciences cognitives computationnelles au MIT et membre du Center for Brains, Minds, and Machines. Igor Mordatch, chercheur chez Google DeepMind, était également co-auteur.