Recherche

Les agents coopèrent mieux en communiquant et en négociant, et sanctionner les promesses non tenues les aide à rester honnêtes.

Une communication et une coopération réussies ont été cruciales pour aider les sociétés à progresser tout au long de l’histoire. Les environnements fermés des jeux de société peuvent servir de bac à sable pour modéliser et étudier les interactions et la communication – et nous pouvons apprendre beaucoup en y jouant. Dans notre récent article, publié aujourd'hui dans Nature Communicationsnous montrons comment les agents artificiels peuvent utiliser la communication pour mieux coopérer dans le jeu de société Diplomatie, un domaine dynamique de la recherche sur l'intelligence artificielle (IA), connu pour son accent sur la création d'alliances.

La diplomatie est un défi car elle a des règles simples mais une grande complexité émergente en raison des fortes interdépendances entre les joueurs et de son immense espace d'action. Pour aider à résoudre ce défi, nous avons conçu des algorithmes de négociation qui permettent aux agents de communiquer et de se mettre d'accord sur des plans communs, leur permettant ainsi de vaincre les agents dépourvus de cette capacité.

La coopération est particulièrement difficile lorsque nous ne pouvons pas compter sur nos pairs pour tenir leurs promesses. Nous utilisons la diplomatie comme un bac à sable pour explorer ce qui se passe lorsque des agents peuvent s'écarter de leurs accords passés. Nos recherches illustrent les risques qui apparaissent lorsque des agents complexes sont capables de déformer leurs intentions ou d’induire les autres en erreur sur leurs projets futurs, ce qui soulève une autre grande question : quelles sont les conditions qui favorisent une communication et un travail d’équipe dignes de confiance ?

Nous montrons que la stratégie consistant à sanctionner les pairs qui rompent leurs contrats réduit considérablement les avantages qu'ils peuvent tirer en abandonnant leurs engagements, favorisant ainsi une communication plus honnête.

Qu'est-ce que la diplomatie et pourquoi est-elle importante ?

Des jeux comme échecs, poker, Alleret beaucoup jeux vidéo ont toujours été un terrain fertile pour la recherche en IA. Diplomatie est un jeu de négociation et de formation d'alliances à sept joueurs, joué sur une ancienne carte de l'Europe divisée en provinces, où chaque joueur contrôle plusieurs unités (règles de la diplomatie). Dans la version standard du jeu, appelée Press Diplomacy, chaque tour comprend une phase de négociation, après laquelle tous les joueurs révèlent simultanément les coups choisis.

Le cœur de la diplomatie est la phase de négociation, où les joueurs tentent de se mettre d'accord sur leurs prochains mouvements. Par exemple, une unité peut soutenir une autre unité, lui permettant de surmonter la résistance des autres unités, comme illustré ici :

Deux scénarios de mouvement.

Gauche: deux unités (une unité rouge en Bourgogne et une unité bleue en Gascogne) tentent de s'installer à Paris. Comme les unités ont la même force, aucune ne réussit.

Droite: l'unité Rouge en Picardie soutient l'unité Rouge en Bourgogne, maîtrisant l'unité Bleue et permettant à l'unité Rouge d'entrer en Bourgogne.

Des approches informatiques de la diplomatie ont été étudiées depuis les années 1980, dont beaucoup ont été explorées sur une version plus simple du jeu appelée No-Press Diplomacy, où la communication stratégique entre les joueurs n'est pas autorisée. Les chercheurs ont également proposé protocoles de négociation informatisésparfois appelé « Restricted-Press ».

Qu’avons-nous étudié ?

Nous utilisons la diplomatie comme un analogue de la négociation du monde réel, en fournissant aux agents IA des méthodes pour coordonner leurs mouvements. Nous prenons nos agents Diplomatiques non-communicants et augmentez-les pour qu'ils jouent à la diplomatie avec la communication en leur donnant un protocole de négociation de contrats pour un plan d'action commun. Nous appelons ces agents augmentés des négociateurs de base, et ils sont liés par leurs accords.

Contrats diplomatiques.

Gauche: une restriction permettant seulement certaines actions au joueur Rouge (il n'est pas autorisé à se déplacer de la Ruhr vers la Bourgogne, et doit se déplacer du Piémont vers Marseille).

Droite: Un contrat entre les joueurs Rouge et Vert, qui impose des restrictions des deux côtés.

Nous considérons deux protocoles : le protocole de proposition mutuelle et le protocole de proposition-choix, discutés en détail dans le document complet. Nos agents appliquent des algorithmes qui identifient les accords mutuellement avantageux en simulant la façon dont le jeu pourrait se dérouler dans le cadre de divers contrats. Nous utilisons le Solution de négociation Nash depuis la théorie des jeux comme base de principe pour identifier des accords de haute qualité. Le jeu peut se dérouler de plusieurs manières en fonction des actions des joueurs, c'est pourquoi nos agents utilisent des simulations de Monte-Carlo pour voir ce qui pourrait se passer au prochain tour.

Simulation des états suivants étant donné un contrat convenu. À gauche : état actuel d'une partie du plateau, y compris un contrat convenu entre les joueurs Rouge et Vert. À droite : plusieurs états suivants possibles.

Nos expériences montrent que notre mécanisme de négociation permet aux négociateurs de base de surpasser considérablement les agents non communicants de base.

Les négociateurs de base surpassent largement les agents non communicants. Gauche : Le protocole de proposition mutuelle. À droite : le protocole Proposer-Choisir. « L’avantage du négociateur » est le rapport des taux de victoire entre les agents communicants et les agents non communicants.

Agents rompant les accords

En diplomatie, les accords conclus lors de la négociation ne sont pas contraignants (la communication est «discours bon marché''). Mais que se passe-t-il lorsque des agents qui acceptent un contrat à un moment donné s’en écartent au tour suivant ? Dans de nombreux contextes réels, les gens acceptent d’agir d’une certaine manière, mais ne parviennent pas à respecter leurs engagements par la suite. Pour permettre la coopération entre agents d’IA, ou entre agents et humains, nous devons examiner le piège potentiel que représentent les agents qui rompent stratégiquement leurs accords, ainsi que les moyens de remédier à ce problème. Nous avons utilisé la diplomatie pour étudier comment la capacité d'abandonner nos engagements érode la confiance et la coopération, et identifier les conditions qui favorisent une coopération honnête.

Nous considérons donc les agents déviateurs, qui surpassent les négociateurs de base honnêtes en s'écartant des contrats convenus. Les simples déviateurs « oublient » simplement qu’ils ont accepté un contrat et bougent comme ils le souhaitent. Les déviateurs conditionnels sont plus sophistiqués et optimisent leurs actions en supposant que les autres joueurs qui ont accepté un contrat agiront conformément à celui-ci.

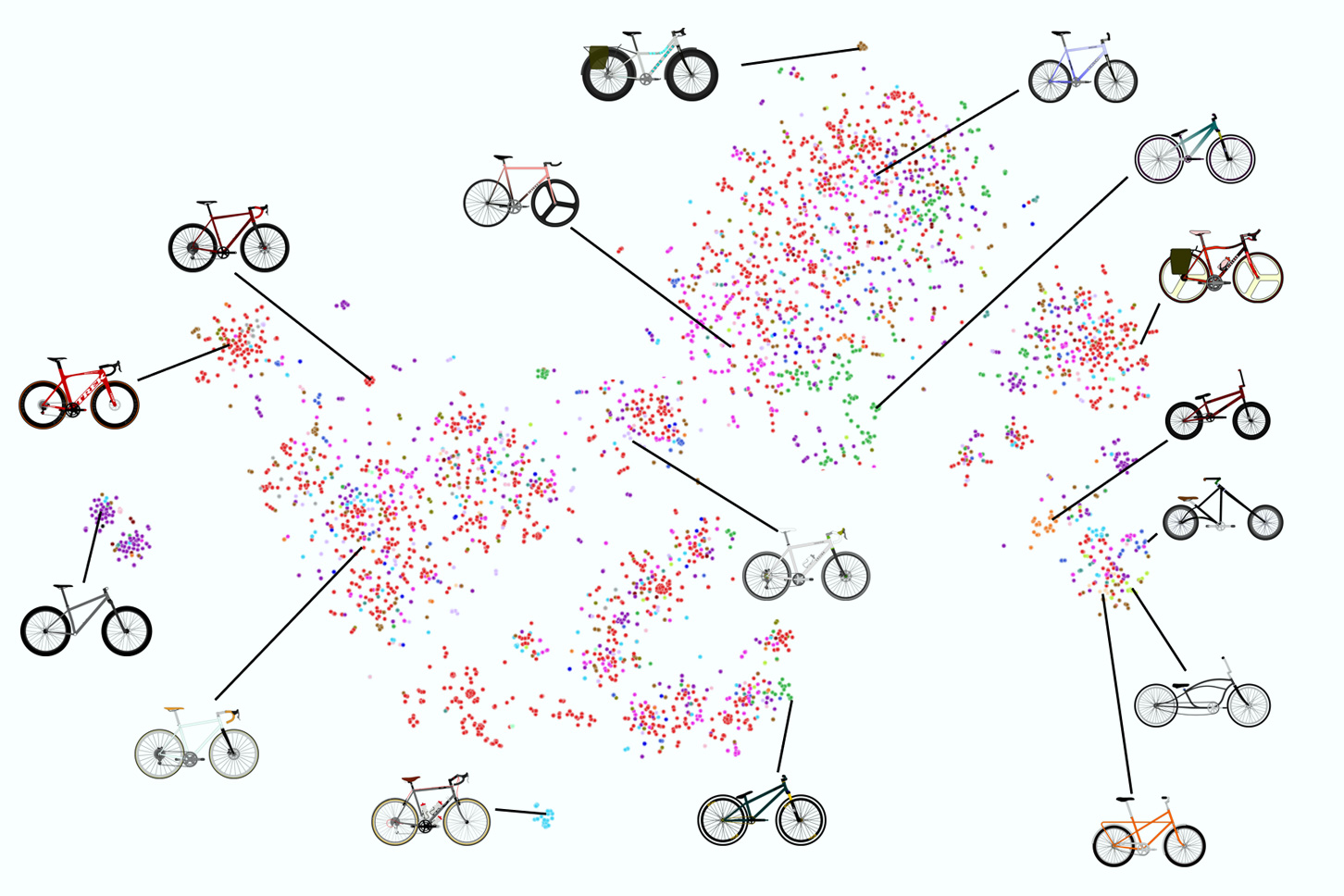

Tous types de nos Agents Communicants. Sous les termes de regroupement verts, chaque bloc bleu représente un algorithme d'agent spécifique.

Nous montrons que les déviateurs simples et conditionnels surpassent considérablement les négociateurs de base, et que les déviateurs conditionnels le sont largement.

Agents déviateurs versus agents négociateurs de base. Gauche : Le protocole de proposition mutuelle. À droite : le protocole Proposer-Choisir. « L'avantage du déviateur » est le rapport des taux de victoire entre les agents déviateurs et les négociateurs de base.

Encourager les agents à être honnêtes

Ensuite, nous abordons le problème des déviations en utilisant des agents défensifs, qui réagissent négativement aux déviations. Nous enquêtons sur les négociateurs binaires, qui coupent simplement les communications avec les agents qui rompent un accord avec eux. Mais l'évitement est une réaction douce, c'est pourquoi nous développons également des agents de sanction, qui ne prennent pas la trahison à la légère, mais modifient plutôt leurs objectifs pour tenter activement de réduire la valeur du déviateur – un adversaire rancunier ! Nous montrons que les deux types d’agents défensifs réduisent l’avantage de la déviation, en particulier les agents sanctionnants.

Agents non-déviateurs (négociateurs de base, négociateurs binaires et agents de sanction) jouant contre des déviateurs conditionnels. Gauche : Protocole de proposition mutuelle. À droite : Proposer-Choisir le protocole. Les valeurs « avantage du déviateur » inférieures à 1 indiquent qu'un agent défensif surpasse un agent déviateur. Une population de négociateurs binaires (bleu) réduit l’avantage des déviateurs par rapport à une population de négociateurs de base (gris).

Enfin, nous présentons les Déviateurs Érudits, qui adaptent et optimisent leur comportement contre les Agents Sanctionnants sur plusieurs parties, essayant de rendre les défenses ci-dessus moins efficaces. Un déviateur érudit ne rompra un contrat que lorsque les gains immédiats résultant de la déviation sont suffisamment élevés et que la capacité de l'autre agent à riposter est suffisamment faible. Dans la pratique, les Déviateurs érudits rompent parfois des contrats en fin de partie et obtiennent ainsi un léger avantage sur les Agents sanctionnants. Néanmoins, de telles sanctions conduisent le Savant Deviator à honorer plus de 99,7% de ses contrats.

Nous examinons également les dynamiques d’apprentissage possibles en matière de sanction et de déviation : que se passe-t-il lorsque les agents sanctionnants peuvent également s’écarter des contrats, et l’incitation potentielle à cesser de sanctionner lorsque ce comportement est coûteux. De tels problèmes peuvent progressivement éroder la coopération, de sorte que des mécanismes supplémentaires tels que la répétition d'interactions sur plusieurs jeux ou l'utilisation de systèmes de confiance et de réputation peuvent être nécessaires.

Notre article laisse de nombreuses questions ouvertes pour de futures recherches : est-il possible de concevoir des protocoles plus sophistiqués pour encourager un comportement encore plus honnête ? Comment gérer la combinaison de techniques de communication et d’informations imparfaites ? Enfin, quels autres mécanismes pourraient dissuader la rupture des accords ? Construire des systèmes d'IA équitables, transparents et fiables est un sujet extrêmement important et constitue un élément clé de la mission de DeepMind. L’étude de ces questions dans des bacs à sable comme la diplomatie nous aide à mieux comprendre les tensions entre coopération et concurrence qui pourraient exister dans le monde réel. En fin de compte, nous pensons que relever ces défis nous permettra de mieux comprendre comment développer des systèmes d'IA conformes aux valeurs et aux priorités de la société.

Lire notre article complet ici.